Artificiell intelligens har på kort tid gått från att vara ett tekniskt utvecklingsområde till att bli en fråga för hela organisationen. Nya verktyg utvecklas snabbt, modeller blir allt mer avancerade och möjligheterna verkar nästan obegränsade. Samtidigt växer en annan insikt fram i många verksamheter. AI förändrar inte bara tekniklandskapet. Den påverkar också hur beslut fattas, hur ansvar behöver fördelas och hur organisationer arbetar med struktur, styrning och kommunikation i praktiken. Det är mot den bakgrunden som AI Act i organisationer har blivit en central fråga, inte bara juridiskt, utan i hur verksamheter leds och organiseras.

När organisationer börjar arbeta praktiskt med AI blir det snabbt tydligt att AI Act inte främst handlar om teknik. Den handlar om hur organisationer använder teknik och hur ansvar tas för den användningen.

AI uppstår inte i ett vakuum. Den utvecklas, implementeras och används i organisatoriska sammanhang där människor, beslut och strukturer alltid är en del av helheten. Det är därför frågor om ledarskap, kommunikation och ansvar blir centrala när AI introduceras i en verksamhet. För organisationer innebär AI Act därför inte bara nya tekniska krav, utan också nya krav på styrning, ansvar och transparens i hur AI används i verksamheten.

Vad är AI Act?

EU:s AI Act, även kallad ai-förordningen, är världens första omfattande lagstiftning för artificiell intelligens. Regelverket syftar till att skapa förutsättningar för tillförlitlig och ansvarsfull AI i Europa (European Commission, 2024). Kärnan är en riskbaserad modell — all AI behandlas inte på samma sätt, utan kraven anpassas efter vilken risk tekniken kan innebära för människor och samhälle.

Fyra risknivåer i AI Act

Oacceptabel risk

AI-system som anses hota människors säkerhet eller grundläggande rättigheter är förbjudna. Exempel är manipulation genom AI, social scoring eller massinsamling av biometriska data.

Hög risk

AI-system som kan påverka människors möjligheter i livet omfattas av strikta krav. Det gäller till exempel AI i rekrytering, kreditbedömning, utbildning eller kritisk infrastruktur. Organisationer som använder sådana system behöver bland annat säkerställa transparens, dokumentation och mänsklig tillsyn.

Begränsad risk

Här krävs främst transparens kring att AI används. Användare ska till exempel informeras om när de interagerar med ett automatiserat system.

Minimal risk

Den största delen av dagens AI-användning hamnar i denna kategori. Det gäller exempelvis rekommendationssystem, spamfilter eller enklare automatiseringar där påverkan på människor är begränsad.

Det avgörande i modellen är att risk inte enbart kopplas till teknikens komplexitet. Risk uppstår i hur AI används och i vilka organisatoriska sammanhang den används, där samspelet mellan människa, teknik och organisation blir avgörande. Det innebär att samma teknik kan omfattas av olika krav beroende på hur och var den implementeras i en verksamhet.

Kärnan i EU:s AI Act är en riskbaserad reglering av AI-system. Det innebär att all AI inte behandlas på samma sätt i lagstiftningen. I stället anpassas kraven efter vilken risk tekniken kan innebära för människor och samhälle (European Commission, 2024).

AI Act möter organisationens verklighet

När AI börjar användas i organisationer uppstår snabbt frågor som inte är tekniska utan organisatoriska.

- Vem ansvarar för beslut som fattas med stöd av AI?

- Hur säkerställs transparens kring hur systemen fungerar?

- Hur utbildas medarbetare så att tekniken används på ett ansvarsfullt sätt?

- Hur kommunicerar organisationen kring AI, både internt och externt?

AI Act pekar indirekt på att AI behöver hanteras som en del av organisationens styrning och ledning, inte bara som en teknisk lösning.

AI som en del av organisationens styrning

Det innebär att AI-initiativ behöver kopplas till strategi, ansvarsfördelning, kompetensutveckling och kommunikation, och förstås som en del av organisationens digitala transformation. Forskning om organisationer visar också att strukturer, roller och samordning är avgörande för hur nya arbetssätt faktiskt fungerar i praktiken (Alvehus & Jensen, 2022).

Organisationer som lyckas med AI är därför sällan de som enbart satsar på teknik. De är ofta de som lyckas kombinera teknisk utveckling med tydligt ledarskap och en organisation som förstår vad tekniken innebär i praktiken. Ledarskap och ansvarsfördelning spelar här en central roll i hur nya initiativ tas emot och integreras i organisationen (Andersson et al., 2021).

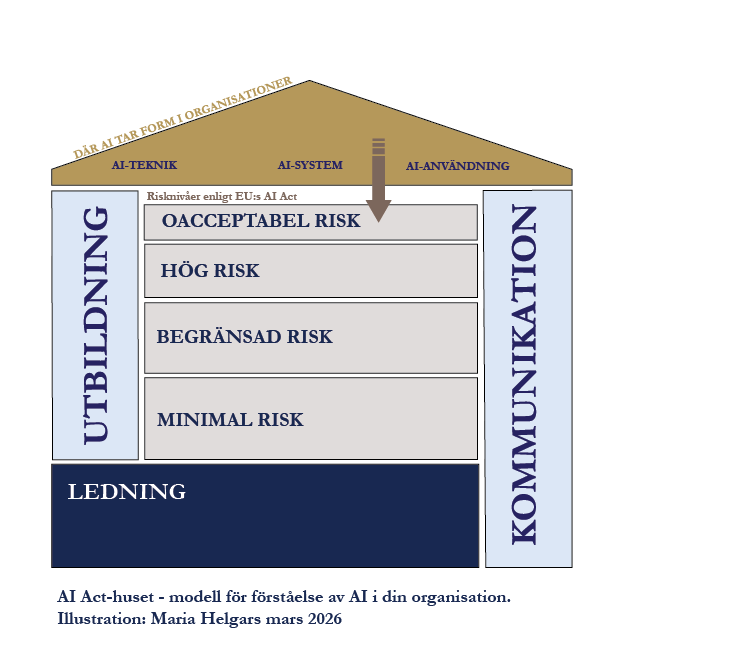

AI-Act-huset visar hur AI faktiskt används

I arbetet med denna artikel har jag utvecklat modellen AI-Act-huset som ett sätt att visualisera hur EU:s AI Act möter verkligheten i organisationer. Modellen är inte en förenklad bild av lagtexten, utan ett försök att översätta regelverket till ett organisatoriskt perspektiv.

Den har vuxit fram genom en kombination av studier, forskning om organisation och ledarskap samt dialoger med personer som arbetar praktiskt med AI, digitalisering och förändringsarbete i organisationer. I mötet mellan dessa perspektiv blir det tydligt att AI sällan är ett isolerat teknikprojekt. Den påverkar hur organisationer fattar beslut, hur ansvar fördelas och hur människor arbetar tillsammans.

AI-act huset rör sig från teknik till användning

AI-Act-huset är därför utformat för att visa hur AI rör sig från teknik till faktisk användning i verksamheter. I husets tak syns de nivåer där AI tar form i organisationer: tekniken utvecklas, byggs in i system och används sedan i konkreta arbetssituationer. Det är först i den sista nivån, när AI appliceras i organisationens arbete och beslut, som tekniken får verkliga konsekvenser.

Under taket ligger AI Acts risknivåer. De visar hur olika typer av AI omfattas av olika krav beroende på vilken påverkan användningen kan få. Risknivåerna handlar därför inte bara om teknikens egenskaper, utan om var och hur AI används i organisationer.

Modellens grund består av ledarskap, och stöttande väggar är utbildning och kommunikation. Det är de organisatoriska förutsättningar som gör det möjligt att använda AI på ett ansvarsfullt sätt. Utan dessa delar blir lagstiftning, riktlinjer och tekniska lösningar svåra att omsätta i praktiken.

Syftet med modellen Ai-act huset

Syftet med modellen är att skapa en tydligare förståelse för hur AI Act, organisationsstruktur och praktisk användning av AI hänger ihop. När AI betraktas i detta bredare sammanhang blir det också tydligare varför AI-reglering i grunden handlar om organisation, ansvar och genomförande, inte bara om teknik.

Kompetens och utbildning blir avgörande

När organisationer börjar arbeta med AI uppstår ofta ett glapp mellan teknikens utveckling och organisationens förståelse.

Nya verktyg börjar användas snabbt. Samtidigt saknas ofta riktlinjer, utbildning och en gemensam förståelse för hur tekniken bör användas i verksamheten. Det kan leda till osäkerhet kring ansvar, bristande transparens eller att AI används på sätt som organisationen inte fullt ut har överblick över.

Det är därför kompetensutveckling blir en central del i arbetet med AI Act.

Vad behöver utvecklas för att bygga AI i verksamheter

Organisationer behöver utveckla kunskap om både teknikens möjligheter och dess begränsningar. Medarbetare behöver förstå hur AI fungerar, när den kan användas och när mänskliga beslut behöver ta över. Ledningen behöver samtidigt kunna skapa riktlinjer och strukturer som gör att tekniken används på ett ansvarsfullt sätt.

Forskning om digital transformation visar också att teknik i sig sällan är den största utmaningen. Den avgörande faktorn är ofta organisationens förmåga att utveckla rätt kompetens och arbetssätt kring tekniken (Frankiewicz & Chamorro-Premuzic, 2020).

I Sverige arbetar exempelvis AI Sweden med utbildningar och program som hjälper organisationer att förstå och implementera AI Act i praktiken (AI Sweden, 2024). Det visar tydligt att AI-reglering inte enbart handlar om juridik. Den handlar i hög grad om organisationers förmåga att förstå och använda tekniken ansvarsfullt.

Genomförandet är den verkliga utmaningen med AI Act

När AI diskuteras ligger fokus ofta på teknik och innovation. Men i många organisationer visar erfarenheten något annat. Den största utmaningen ligger inte i att utveckla tekniken. Den ligger i att få nya arbetssätt att fungera i vardagen. AI Act i organisationer handlar därför i slutänden om förmågan att omsätta krav till fungerande arbetssätt.

AI-system behöver kopplas till verksamhetens processer. Medarbetare behöver förstå hur systemen fungerar och hur resultaten ska tolkas. Beslutsfattare behöver kunna ta ansvar för hur tekniken används i organisationens arbete.

Det innebär att AI i praktiken blir ett förändringsarbete.

Ai som förändringsarbete i organisationer

Nya verktyg påverkar hur människor arbetar, hur beslut fattas och hur ansvar fördelas i organisationen. Forskning om organisation och ledarskap visar att sådana förändringar ofta kräver tydlig samordning, gemensamma arbetssätt och en organisation där roller och ansvar är tydliga (Alvehus & Jensen, 2022; Andersson et al., 2021).

När dessa delar finns på plats kan AI bli ett kraftfullt stöd i verksamheten. När de saknas riskerar tekniken i stället att skapa otydlighet, felaktiga beslut eller bristande ansvar. AI Act gör därför något viktigt synligt: att AI inte bara är en teknisk fråga, utan också en organisatorisk.

AI Act visar att AI ytterst är en ledarskapsfråga

När AI diskuteras hamnar fokus ofta på algoritmer, modeller eller data. Men i praktiken visar AI Act något annat.

AI handlar i slutänden om hur organisationer använder teknik och vilket ansvar de är beredda att ta för den användningen.

Regelverket gör tydligt att AI inte kan hanteras enbart som ett teknikprojekt. Organisationer behöver också arbeta med ledarskap, ansvarsfördelning, kompetens och kommunikation kring hur tekniken används i verksamheten.

Det innebär att AI i organisationer alltid kommer att vara en fråga om:

- ledarskap

- kommunikation

- kompetens

- ansvar

Tekniken är viktig. Men det är organisationens ledarskap och ansvarstagande som avgör om AI blir ett verkligt stöd i verksamheten, eller bara ännu ett initiativ som aldrig riktigt landar i vardagen.

Vill du veta mer?

Den hysteriska bilden i headern är AI-genererad, jag behöll den för att jag tycker att den är lite rolig, som kontrast till ett allvarligt ämne.

Läs också:

Källor

AI Sweden (2024). AI Act Ready – courses and competence building.

Artificial Intelligence Act. Overview of the EU AI Act.

European Commission (2024). AI Act – Regulation (EU) 2024/1689 laying down harmonised rules on artificial intelligence.

Frankiewicz, B., & Chamorro-Premuzic, T. (2020). Digital Transformation Is About Talent, Not Technology. Harvard Business Review (Bakom betalvägg).

Alvehus, J., & Jensen, T. (2022). Organisationer. Studentlitteratur.

Andersson, T., Crevani, L., Eriksson-Zetterquist, U., & Tengblad, S. (2021). Chefskap, ledarskap och medarbetarskap. Studentlitteratur.

Kom igång idag.

Vill du veta mer? Klicka på knappen nedan, jag ser fram emot att prata med dig.